核心能力

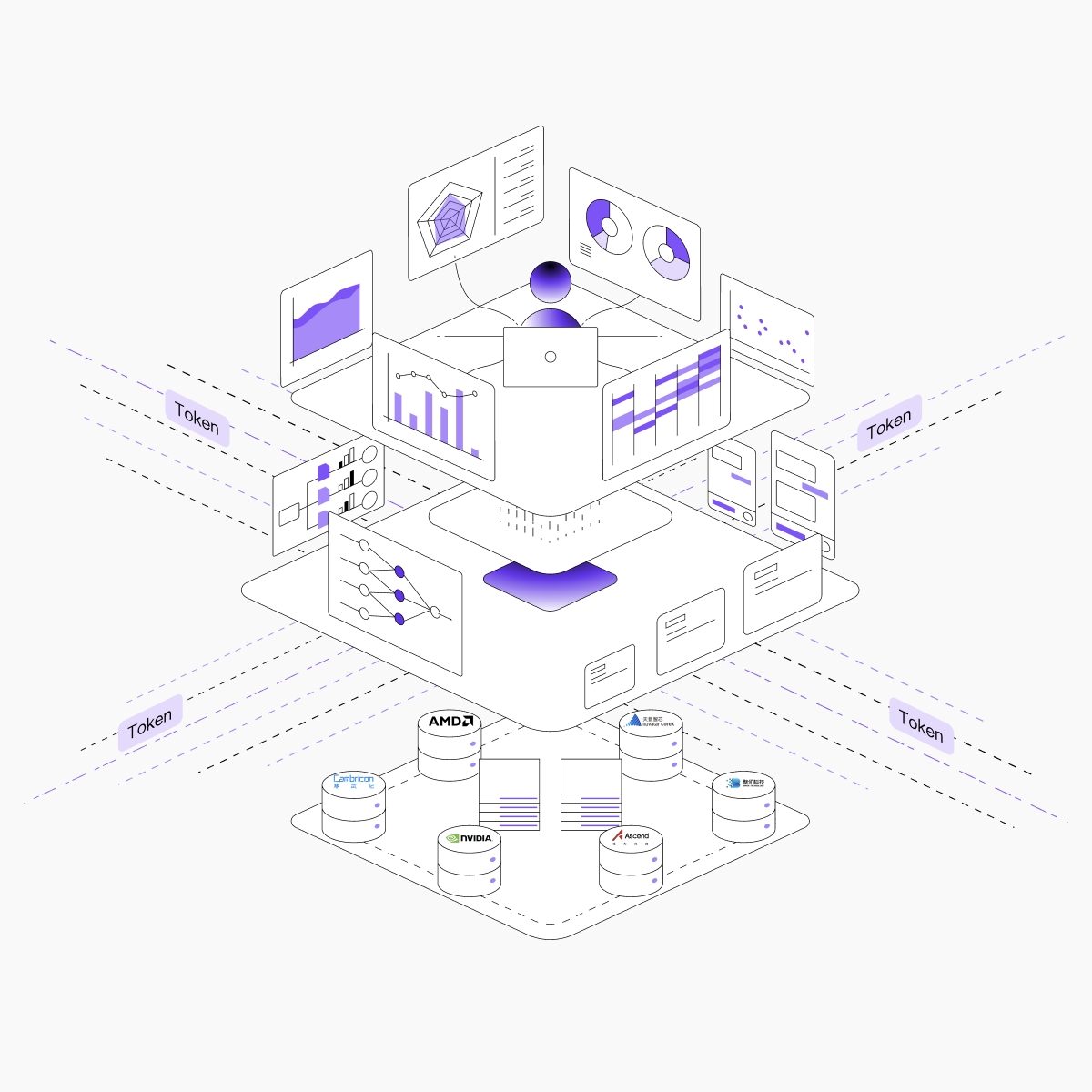

支持英伟达、AMD、华为昇腾、天数、沐曦、寒武纪、壁仞等多种主流AI芯片

自动池化管理与统一调度,屏蔽底层硬件差异

与上层负载调度深度集成优化,实现多种智能调度策略应用和资源高效利用

面向 AI 训练与推理的高性能存储与网络设计,满足多模态数据与大规模分布式计算的吞吐需求

分布式训练优化加速:多节点协同计算的通信优化、通信拓扑自动优化、数据加载优化、启动时延降低

全方位容错机制:异步Checkpoint快速保存恢复,环境机器等多层级异常检测,分钟级任务恢复、迁移

可视化训练监控:实时指标追踪、训练过程可观测、异常自动告警

前沿算法原生支持:非侵入式支持强化学习、具身智能场景的基础设施

超大规模MOE集群推理:支持1T+参数超大模型的分布式推理一键拉起

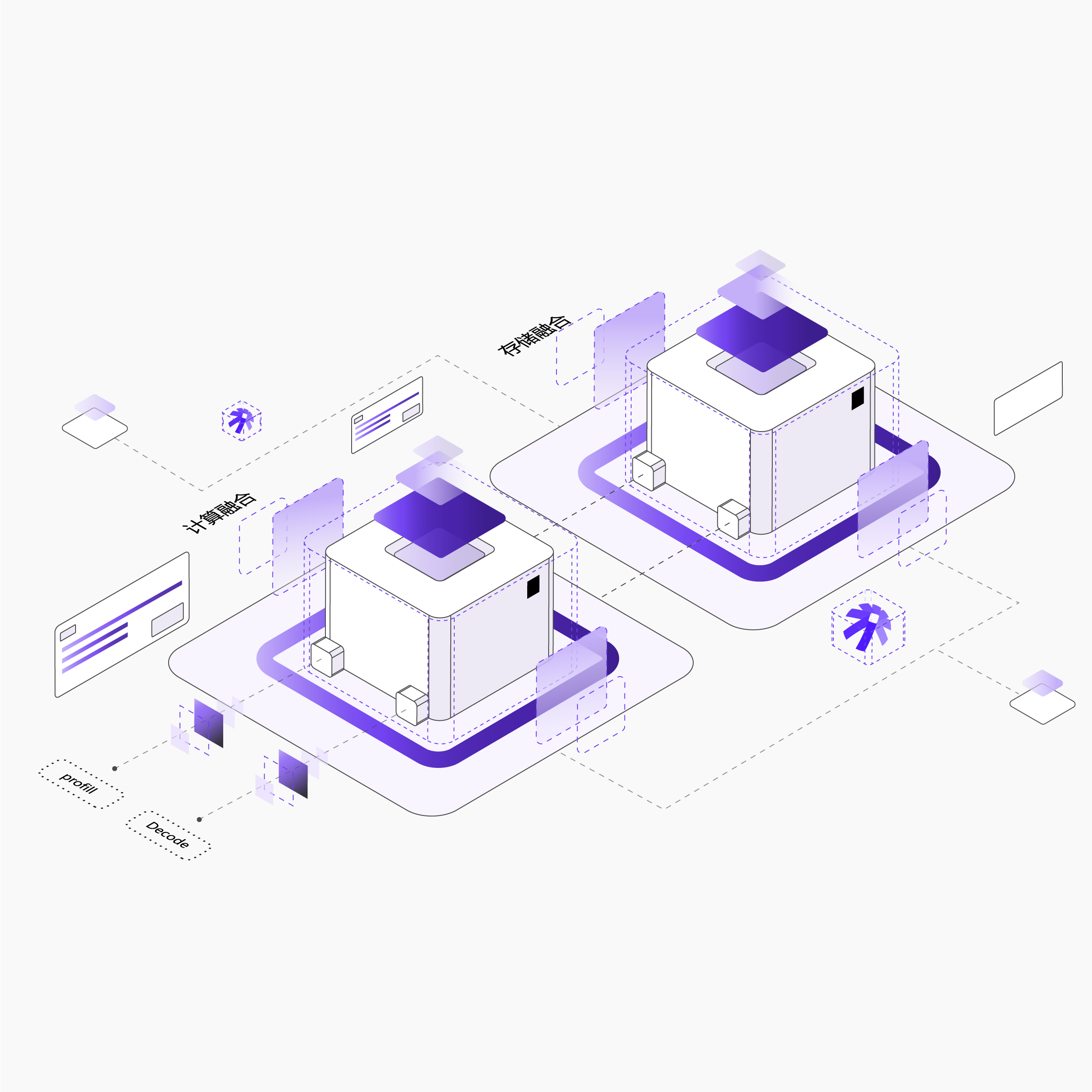

Prefill-Decode分离架构支持:推理集群配置管理,支持多种长度文本生成场景的极致稳定性、性能优化

多模态AIGC优化:支持ComfyUI等多模态工作流的自动异步批量高并发处理,镜像存储缓存加速

弹性扩缩容:多种扩缩容策略支持,支持分钟级百实例弹性扩展,应对流量突发

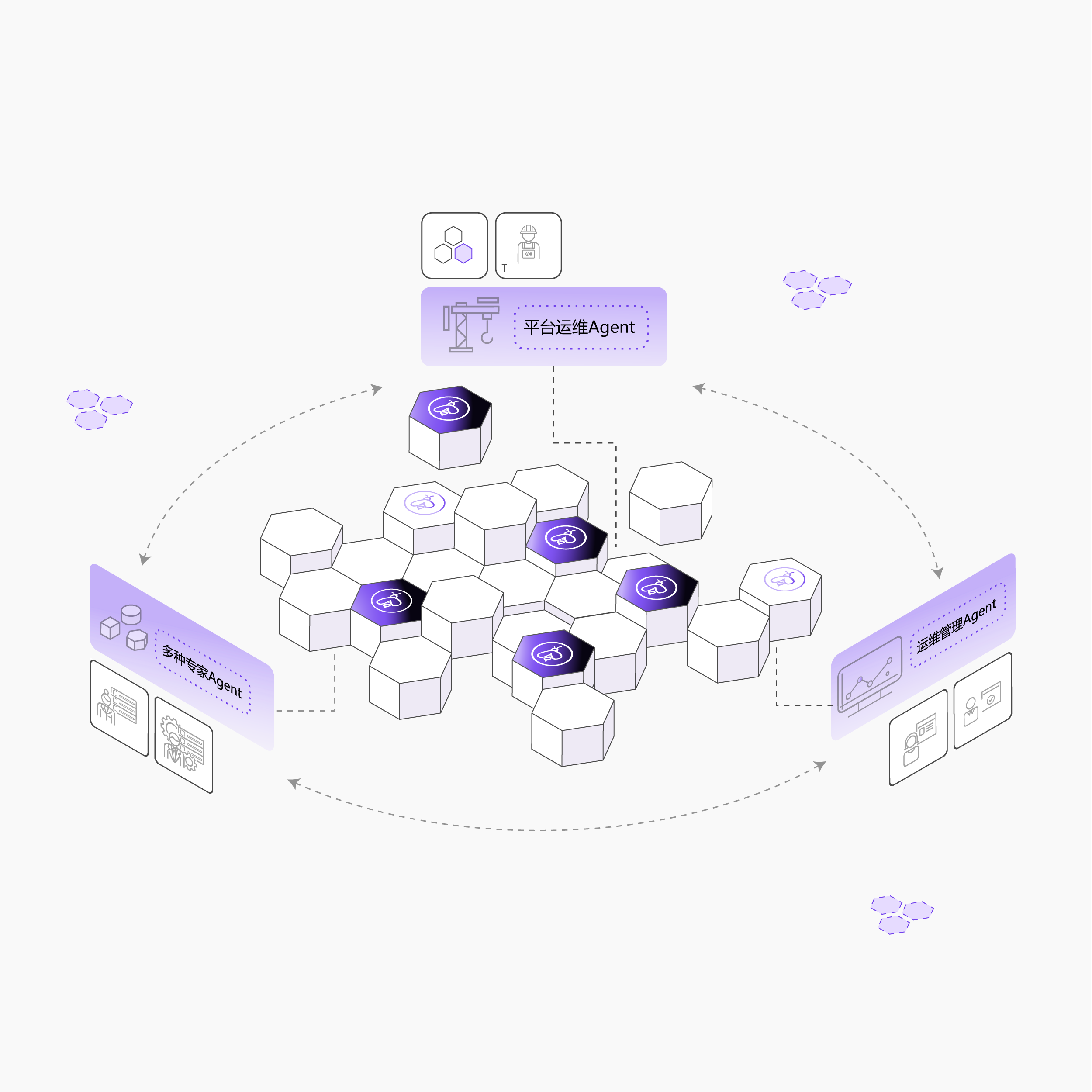

平台运维Agent:集群告警自动分析、异常检测处理、节点智能上下架

运营管理Agent:库存自动管理、负载与资源使用情况智能分析

多Agent协同:平台管家Agent协同资源管理助手、文档智能问答、训练排障等多种专家agent赋能

可靠支撑企业级大模型训练与推理全生命流程

高效构建、稳定运行、智能管理大规模AI基础设施

Agent全程护航,更快、更稳、更省

平台管家Agent

资源管理助手

文档智能问答

训练排障专家

运维Agent

集群告警处理

节点智能上下架

故障自动恢复

运营Agent

库存自动管理

SKU智能变更

活动价格调整

专家Agent 蜂群

多专家协同

智能决策

效率提升

万卡级分布式训练优化

通信加速 数据IO优化 启动时延降低

全方位容错机制

Checkpoint快恢复 分钟级任务恢复

可视化训练监控

实时指标追踪 异常自动告警

超大MOE推理优化

1T+参数 PD分离架构 长文本优化

弹性扩缩容能力

1分钟内百实例扩展 应对流量突发

AIGC工作流优化

日均1000万任务 瞬时20万+并发 加速100%+

多芯片统一纳管

屏蔽硬件差异 统一接口

自动池化管理

资源弹性分配 智能调度

负载深度优化

极致资源利用 性能优化

为什么选择无问芯穹

一套标准基座支持10+种计算芯片, 万卡规模可拓展

针对多种类型的芯片与万卡规模的集群,提供统一的基座标准,实现企业级的大规模纳管与调度:

多元芯片支持:摆脱单一芯片厂商绑定,10+种主流芯片支持,新芯片接入适配时间缩短至天级

智能调度策略优化:预置多种智能调度策略,支持独占资源与临时资源的灵活调度,空闲资源浪费减少 40%+

高可用可拓展:支持从百卡到万卡集群的线性扩展,支持多种异地可用区的灵活配置,系统可用性 >99.9%

全链路监控告警:支持50+ 核心监控指标实时采集

万卡级训练全链路优化, 端到端效率提升35%+

针对万卡以上大模型预训练、后训练、强化学习场景,提供从训练框架到调度层的全链路的端到端优化:

分钟级容错恢复:Checkpoint快速保存与加载,故障自动检测与恢复,训练中断损失降至最低

通信性能优化:多维度通信加速,减少分布式训练中的通信开销

数据IO加速:高效数据加载管线,消除数据读取瓶颈

启动时延优化:快速任务启动与资源分配,缩短实验迭代周期

复杂环境开箱即用:强化学习、具身等算法场景的自动化环境配置管理,降低工程化配置难度

大规模推理极致性价比, 单Token成本降低3倍

面向几百卡以上的生产级推理场景,提供多维度性能优化:

MOE模型优化:支持1T+参数超大规模MOE模型推理,单Token性价比提升3倍以上

PD分离架构支持:Prefill-Decode解耦,针对长文本生成场景的深度优化

弹性扩缩容:1分钟内完成百实例扩展,应对业务流量波动

AIGC工作流优化:支持每日1000万个ComfyUI工作流任务,瞬时并发20万+任务

推理加速:单任务性能优化,推理速度提升100%+

Agent智能化运维, 平台运转效率全面提升28%以上

长期业务打磨,通过Agent体系实现平台的自动化、智能化管理:

故障自愈:运维Agent自动处理集群告警,智能上下架异常节点,故障恢复时间速度提升10倍以上

用户赋能:平台管家Agent提供资源管理、文档问答、训练排障等智能服务

蜂群协作:多专家Agent协同工作,提升模型开发、应用与生成效率

AIGC工作流优化:打通集群、平台等多后台数据,负载与库存感知,自动管理资源库存、价格策略

运营自动化:打通集群、平台等多后台数据,负载与库存感知,自动管理资源库存、价格策略

客户故事

经常在 NCCL 60 分钟的超时阈值内难以完成,导致任务反复容错、训练无法顺利启动

几百B的模型MOE预训练和GRPO,60%-70%概率 2000卡任务跑1小时卡住,无法正常继续

可在15分钟内完成之前同样60分钟卡住的数据初始化问题

同样的训练任务可以正常吞吐稳定运行两周以上

若临时扩容需要等待1-2周从而错失业务流量,购买多余固定集群用于动态扩展的备用资源则会出现闲时的资源浪费,从而导致成本增加。

数据处理和模型训练使用不同的计算资源,工作环境割裂导致整个工作流复杂且难协同,产出物需要跨平台运输

基于平台实现了分钟级动态灵活的资源扩缩容,极大降低生产成本

训推一体,产出模型可以标准化方式快速嵌入到客户自有业务pipeline,模型更新迭代时间降低72%

释放无穹智能,让AGI触手可及

联系我们,获取定制化 AI 基础设施解决方案