为什么现有具身RL训练更难、更慢、更烧卡?

算力浪费严重

明明配了多张 GPU,总有一半在“等”,利用率低

显存分配冲突

仿真器/渲染与模型训练抢占显存,导致资源调度僵化。

Sim2Real 难度大

物理世界无法加速,真机与仿真环境割裂,迁移成本极高。

资源调度僵化

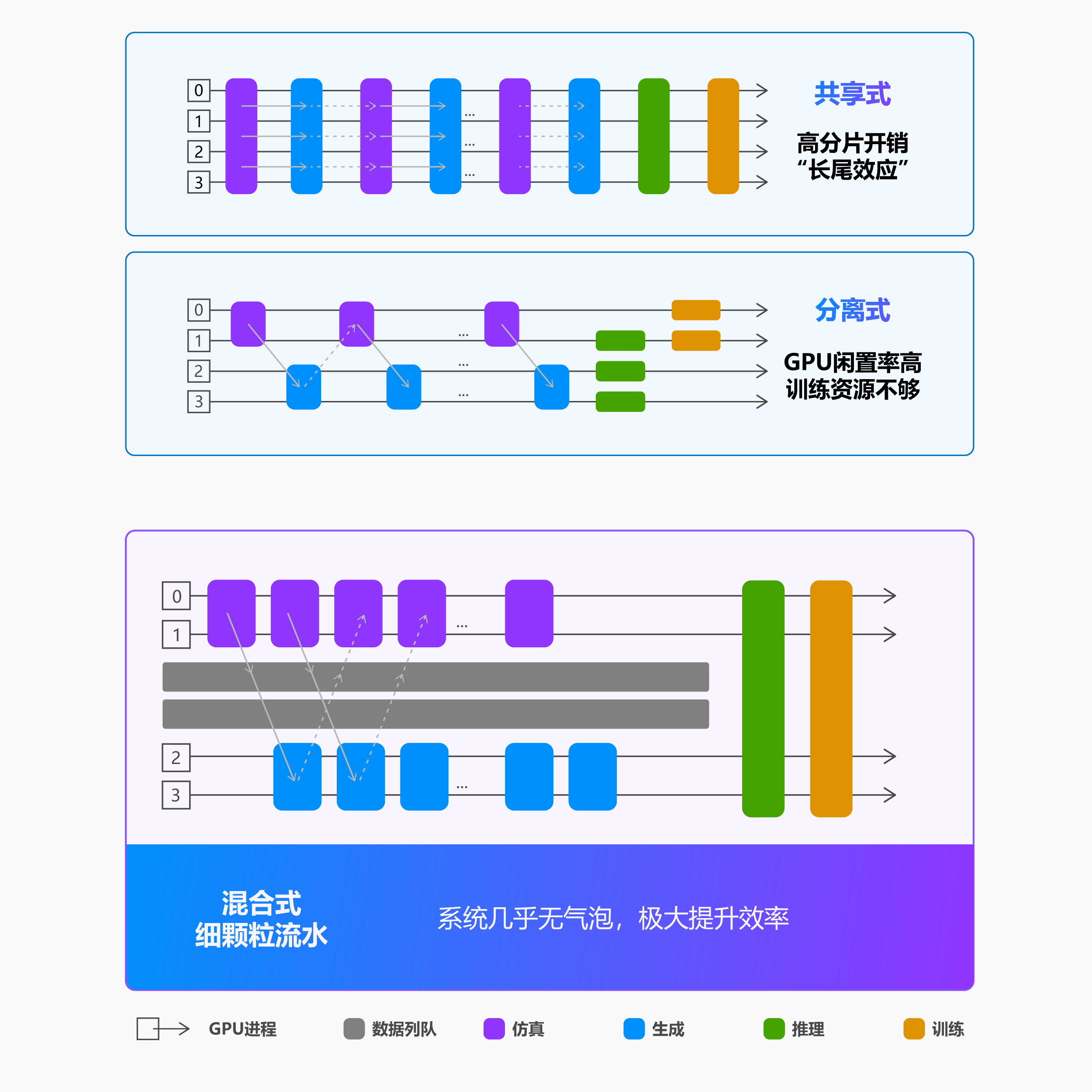

传统系统非共享即分离,无法应对具身智能的异构负载。

活跃的社区和SOTA成果

Apache-2.0 开源协议,每日高频更新,汇聚全球开发者力量

1.5B/7B

数学推理模型支持(SOTA)

10+

支持算法(PPO/SAC/GRPO)

Daily

代码更新频率

Full

cl/测试覆盖

RLinf 框架介绍及核心优势

无问芯穹、清华大学、北京中关村学院联合北大、伯克利等机构重磅推出

于 2025 年 9 月正式开源,开源收获3000+ Star,成为最热门的强化学习框架之一

已被多个学界与工业界具身智能领域的知名研究团队采用。

从用户层到硬件层的完整技术栈

用户层

基于Worker的统一编程接口

任务层

强化学习(PPO, GRPO...)

仿真引擎

训练引擎

训练引擎

低侵入式

组件封装

任务层

灵活执行模式

共享式

分离式

快速加/卸载

细粒度流水

混合式

调度层

自动化调度

动态扩缩

机制

自动调度

策略

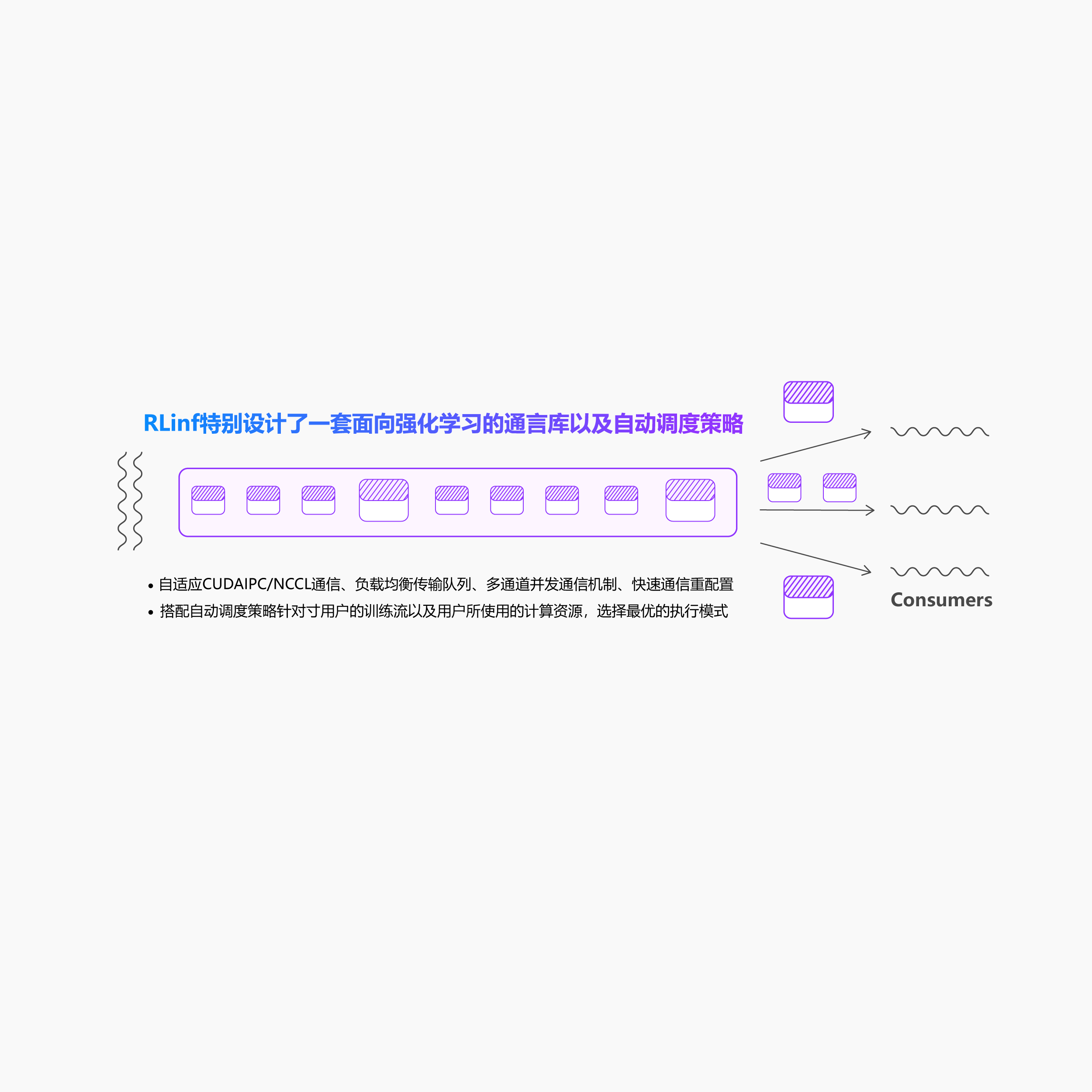

通信层

自适应通讯库

自适应

CUDAIPC/

NCCL通信

强化学习(PPO, GRPO...)

负载均衡

增强队列

快速通信

重配置

硬件层

集群

(CPU,GPU)

核心优势

竞争优势

专为“Render-Train-Inference”一体化设计的下一代基础设施

核心纬度

执行模式

显存利用率

具身仿真支持

真机/模型适配

调度灵活

RLinf(本方案)

执行模式支持

Collocated/Disaggregated/Hybrid

三种模式动态切换

极高(混合调度解决显存竞争)

深度优化(IsaacLab、ManiSkill3等)

开箱即用(OpenVLA,π0 ,Franka)

宏观到微观 流变换

传统RL框架(如CleanRL)

仅支持单机或简易分布式

低(仿真器与模型抢显存)

需自行适配,难度大

无预置支持

静态配置

通用云原生方案

通常为固定流水线,不支持灵活混合

中等(容易产生资源碎片)

通用支持,无特定优化

通用支持,无特定优化

需人工编排

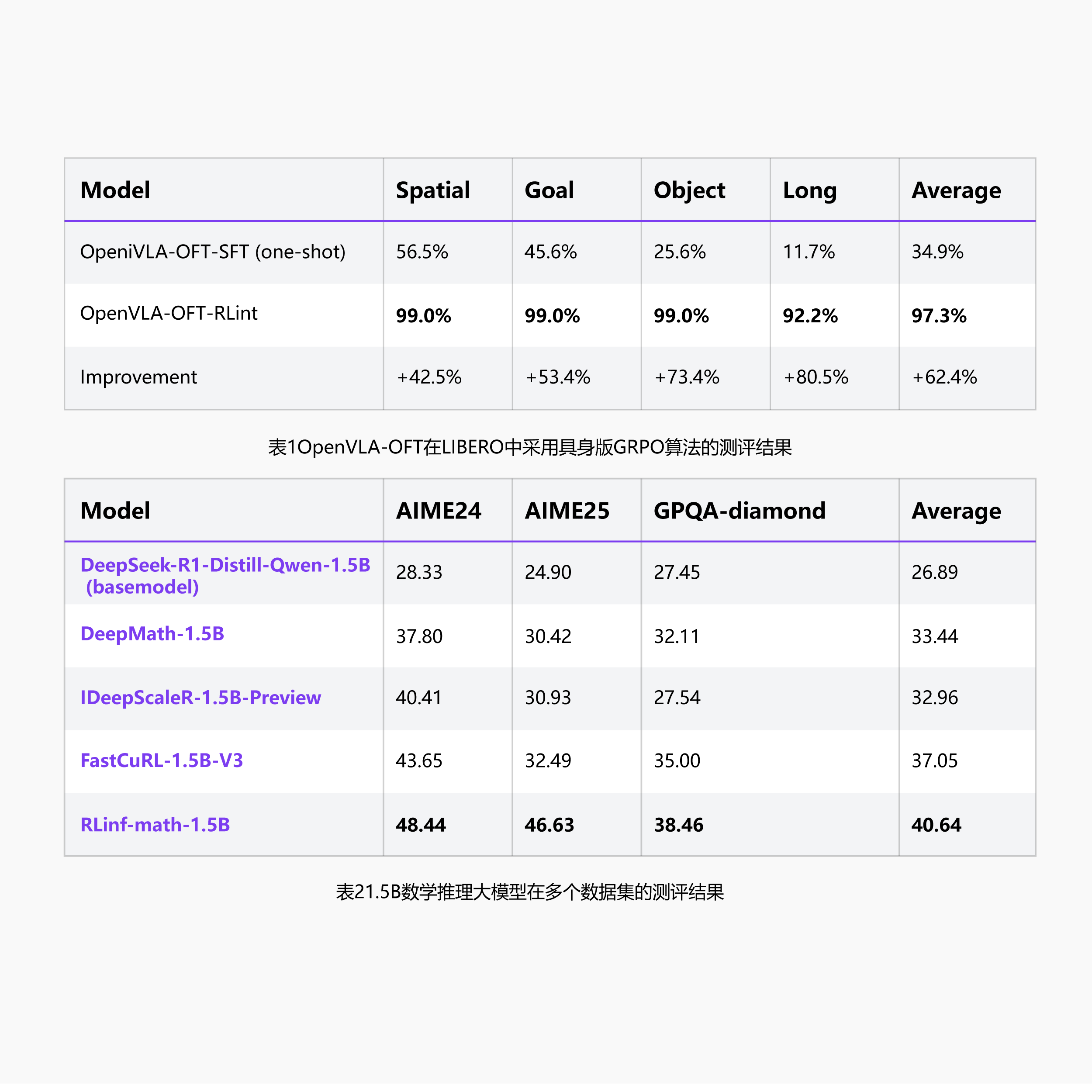

具身场景

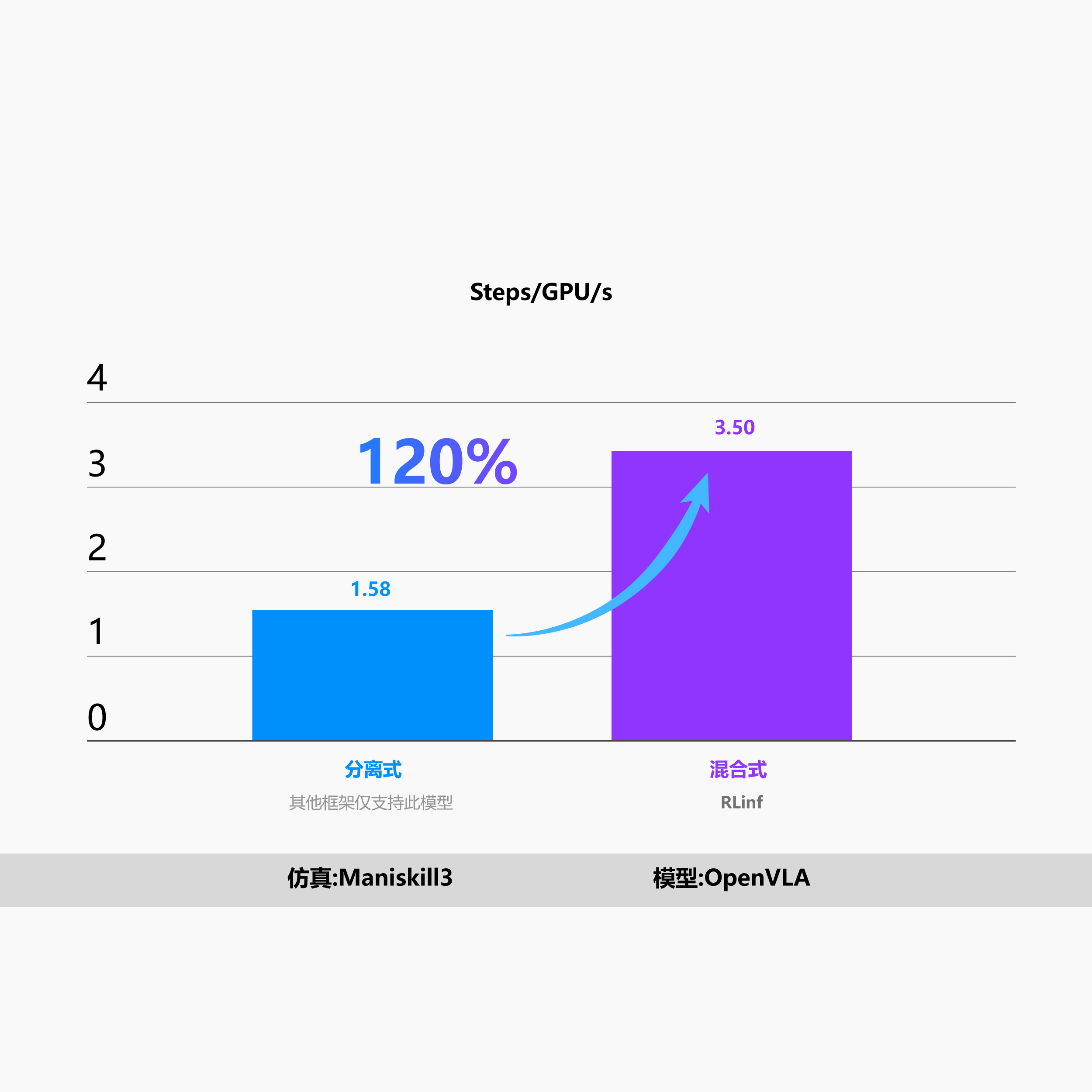

系统效率

120%+

具身VLA

模型涨幅

40~60%

数学推理

3项

SOTA

广泛的生态适配能力

不仅仅是一个框架,更是连接仿真、模型与真机的桥梁

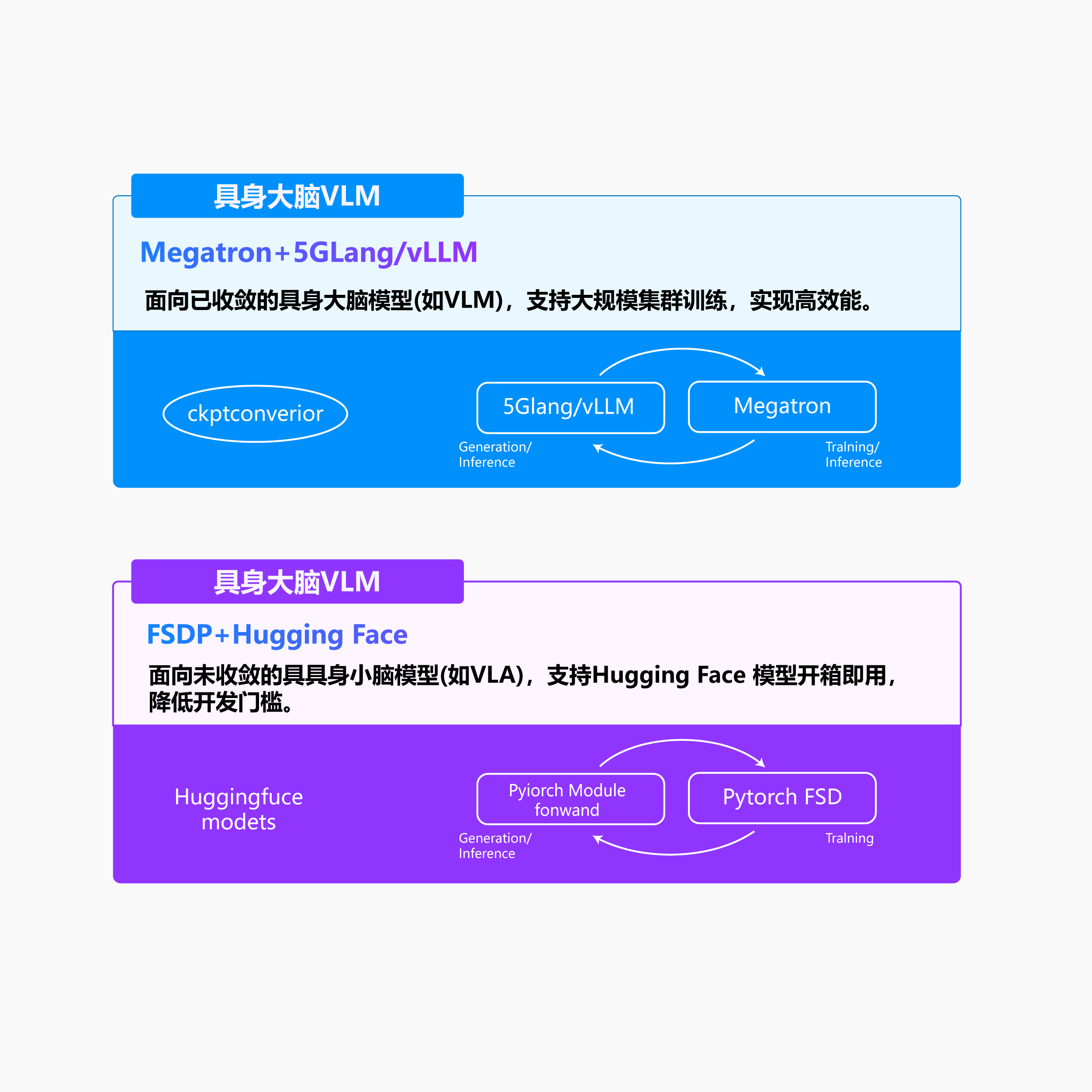

已适配主流模型(VLA / LLM / World Model)

OpenVLA

OpenVLA-OFT

To/ To.s

GRO0T-N1.5

Qwen2.5-VL

OpenSora

仿真平台与真机支持

Isaaclab

Maniskill3

LIBERO

RoboCasa

MetaWorld

Franka Emika (真机)

RoboTwin (R2S2R)

基于丰富的Example Gallery,RLinf 提供从"仿真到真机"的可跑通模板。

LIBERO + OpenVLA-OFT + GRPO

达到 99% Success Rate

提供稳定可靠的具身智能工具链

支撑规模化业务应用,实现降本增效